O Instagram está trabalhando em duas novas ferramentas para diminuir a disseminação de ódio dentro do aplicativo. A primeira consiste em permitir ao usuário restringir uma pessoa que está fazendo comentários impróprios em sua foto, enquanto a segunda trabalha com inteligência artificial capaz de sinalizar comentários ofensivos.

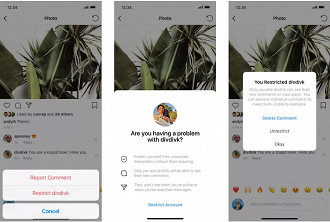

O anúncio foi feito pelo próprio Instagram nesta segunda-feira (08) em seu blog. Segundo a empresa, a próxima ferramenta desenvolvida por eles será a capacidade de restringir os comentários de uma pessoa.

Com um simples toque o usuário poderá optar por "restringir" uma pessoa, o que significa que os comentários feitos por ela serão visíveis apenas para os dois. Além disso, quando o usuário estiver online ou ler uma mensagem direta da pessoa em questão, ela não ficará sabendo.

O objetivo, segundo o Instagram, é empoderar pessoas, ajudando-as a superarem esse tipo de comportamento da melhor forma possível. "Nós ouvimos jovens em nossa comunidade relatando que ficam relutantes em bloquear, deixar de seguir ou denunciar seus bullies porque isso poderia piorar a situação, principalmente se as pessoas interagem na vida real" diz a postagem.

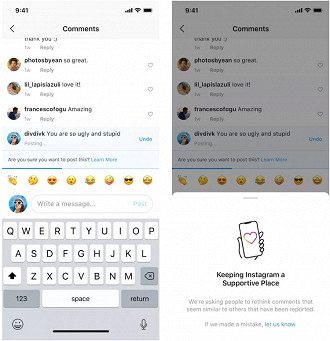

O outro recurso - já desenvolvido - é o uso de inteligência artificial para sinalizar comentários potencialmente ofensivos. O aplicativo então vai perguntar ao usuário, se ele realmente quer seguir com aquela postagem - dando a oportunidade da pessoa de repensar sua atitude e desistir do comentário.

Essa não é a primeira vez que o Instagram luta contra o cyberbullying. Infelizmente, nenhum desses dois recursos garantem que as ofensas irão acabar, mas ao menos é uma tentativa por parte da empresa.

Fonte: blog instagram